Qu’est-ce que Tales of Syn ?

- Développé par un artiste britannique HackmansTales of Syn a commencé à attirer l’attention le mois dernier. Le jeu sera également présenté lors du prochain festival Culture AI Film and Games 2023.

- Tales of Syn est un jeu vidéo et une bande dessinée qui se déroule dans le monde du Giga Bloc C. Il est décrit comme une « métropole tentaculaire dans une période future de la Terre ».

- Il s’agit d’un monde dystopique cyberpunk classique, qui combine haute technologie et vie de misère. Le joueur explorera à la fois les niveaux supérieurs riches, contrôlés par l’Echelon Corporation, et les niveaux inférieurs pauvres, gouvernés par des factions rivales.

- L’un des principaux objectifs du projet est de tester les technologies d’intelligence artificielle émergentes afin de voir comment elles peuvent contribuer à améliorer le processus de conception, tant au niveau de la production que de la narration », peut-on lire dans la section « À propos ».

- Ce qui a vraiment attiré notre attention, c’est une série de billets de blog de Hackmans détaillant la création de personnages et d’autres aspects du développement assisté par l’IA. Ces informations pourraient s’avérer très utiles pour d’autres développeurs, notamment grâce à des décompositions étape par étape.

Tales of Syn, un RPG isométrique que je développe comme une aventure narrative liée à ma bande dessinée. J’explore également l’utilisation d’outils d’IA et de flux de travail pour voir ce qui a du sens dans la production et si une valeur ajoutée est apportée à l’expérience du joueur. #madewithunity #gamedev #indiedev #unity3d pic.twitter.com/3qskhxhHjO

-=HACKMANS=- (@_hackmans_) 11 février 2023

Comment la diffusion stable est-elle utilisée dans les Contes de Syn ?

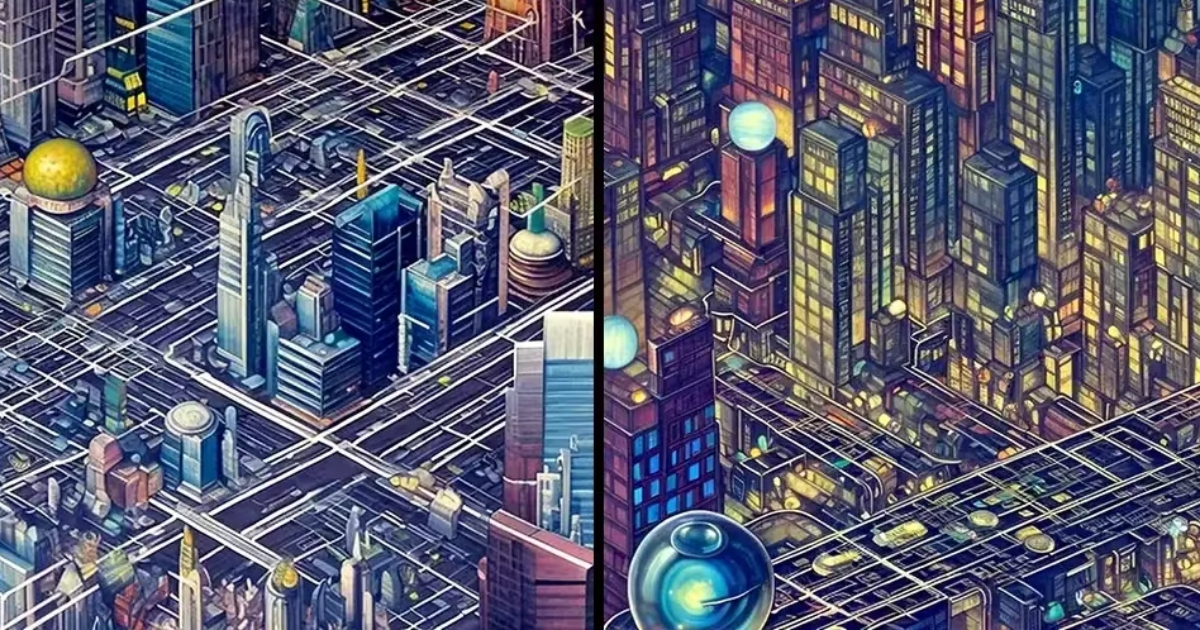

- Hackmans a d’abord décidé d’affiner un modèle personnalisé basé sur des photographies aériennes afin de créer quelques concepts de vues isométriques de paysages urbains.

- L’artiste a utilisé des images Google Earth de villes asiatiques et a créé un ensemble de données de huit images recadrées à 512×512. Hackmans l’a ensuite entraîné comme un style en utilisant l’itération Dreambooth de Joe Penna et a choisi la diffusion stable 1.5 comme modèle de base.

- Les premiers résultats générés ressemblaient déjà à des concepts prometteurs, mais manquaient de qualité d’image et de lignes de route claires.

En haut : Quelques images du jeu de données original de photos Google Earth ; En bas : Deux exemples des premiers concepts de ville générés

- Un autre problème était que Hackmans ne pouvait pas générer de sorties de style pictural. L’artiste a donc décidé de jouer avec Automatic 1111, un outil d’interface utilisateur open-source pour la diffusion stable, et ses fonctions d’édition d’invites.

- « En commençant les générations dans le style entraîné pour les premières étapes et en passant à la peinture à l’huile ou à des modificateurs d’art similaires, cela a fourni une variété beaucoup plus grande de sorties de style qui conservaient toujours l’aspect isométrique aérien », a noté Hackmans.

- Voici quelques résultats générés en utilisant l’invite suivante : « rue d’une ville futuriste, métropole, dystopique, in [<token artstyle>:vibrant oil painting:0.25] »

- Selon Hackmans, de meilleurs résultats peuvent être obtenus en utilisant des images de jeux de données de meilleure qualité et davantage d’exemples de jeux de données.

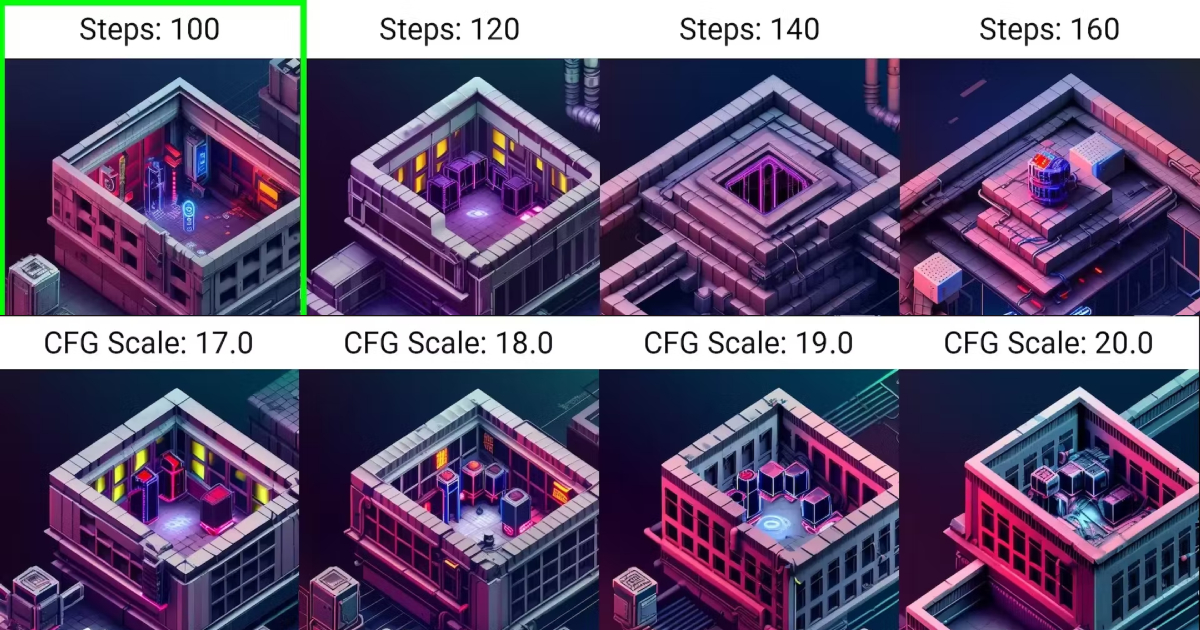

- Hackmans a également utilisé la diffusion stable pour créer des arrière-plans isométriques pour Tales of Syn. L’idée était d’écrire des invites détaillées, en expérimentant avec le nombre d’étapes et différents paramètres pour l’échelle de guidage sans classificateur (échelle CFG). Cette dernière permet d’ajuster la proximité de l’image de sortie par rapport à l’invite et à l’image d’entrée.

- Les premiers résultats décents ont été obtenus lorsque Hackmans a augmenté le nombre d’étapes à la centaine et a réglé CFG à 15-30.

Différentes sorties pour différents pas et paramètres d’échelle CFG

- Pour éditer les images de sortie, Hackmans a utilisé Photoshop pour peindre des couleurs fortes, puis a placé ces arrière-plans dans Unity. L’objectif était de supprimer tout l’éclairage et de l’ajouter en utilisant des shaders personnalisés dans le moteur.

- Dans le billet de blog, Hackmans décrit également les différentes méthodes utilisées pour créer des cartes de profondeur et de normales, ainsi que le processus de création d’ombres pour la scène du jeu et la mise à l’échelle de l’image de sortie pour qu’elle puisse être utilisée comme arrière-plan.

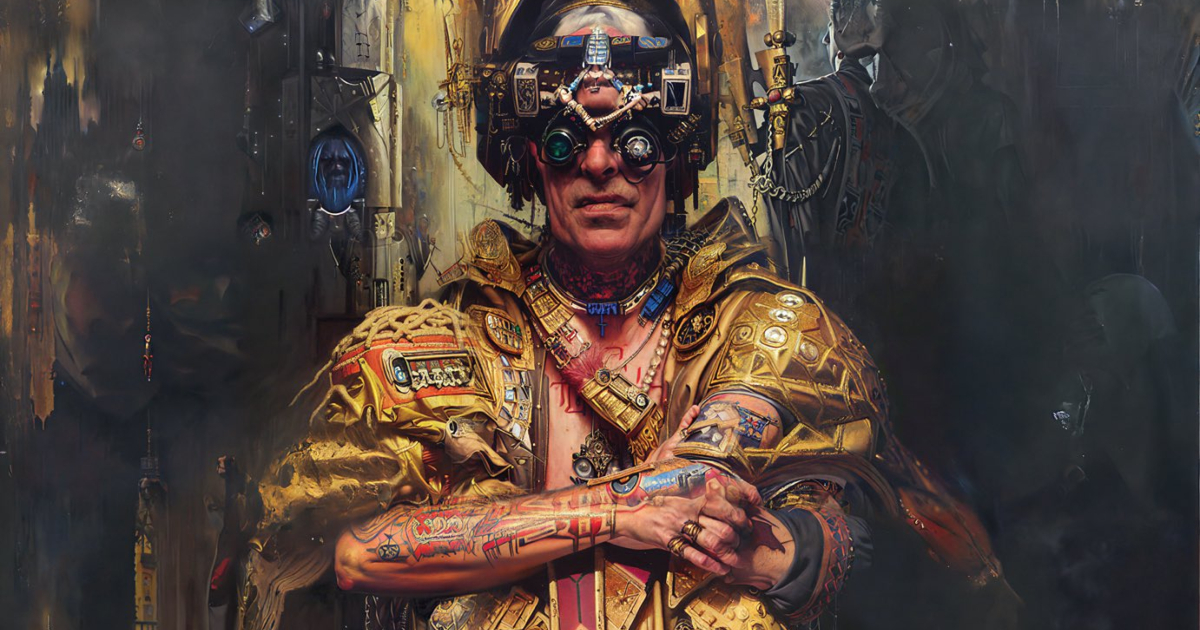

- En ce qui concerne la création de personnages, Hackmans a essayé de trouver un moyen de transformer les images générées par la diffusion stable en modèles 3D. Ces personnages doivent être dans le style de l’univers du jeu et rester cohérents tout au long du pipeline.

- Tout d’abord, Hackmans a dessiné les contours du personnage avec Artstudio Pro sur un guide de référence des proportions qu’ils ont trouvé en ligne. Ensuite, l’artiste a ajouté quelques couleurs et un ombrage de base pour « informer les matériaux et les détails des vêtements lors du traitement de l’image avec Stable Diffusion. »

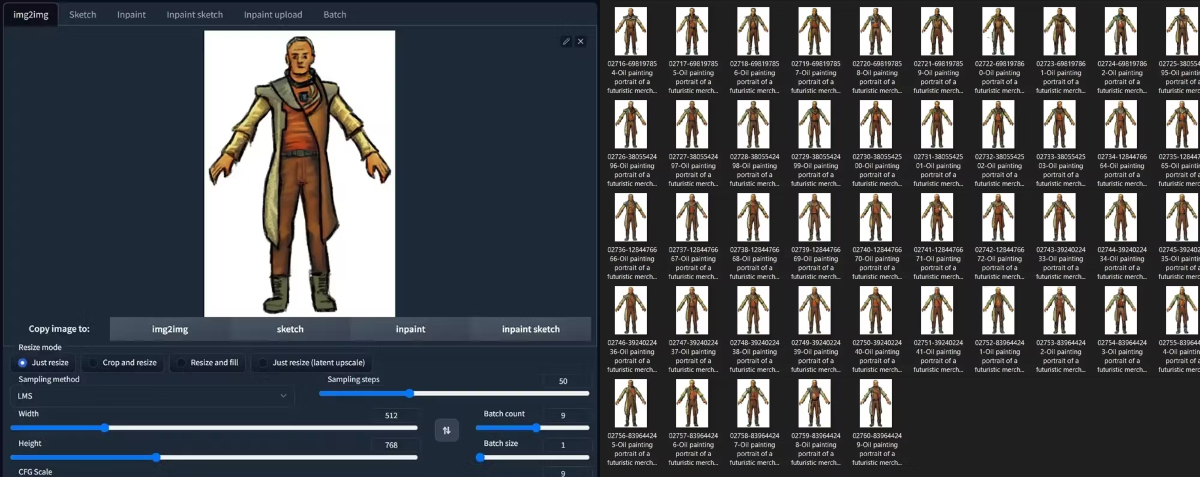

- Hackmans a placé ces croquis dans le générateur img2img d’Automatic 1111 pour obtenir des dizaines de portraits peints à l’huile d’un marchand futuriste.

- Ensuite, Hackmans a choisi les meilleurs résultats et les a ajustés dans Photoshop en superposant les images les unes sur les autres et en ajoutant certains détails ou en supprimant des régions spécifiques.

- L’un des problèmes des images générées par l’IA était la mauvaise qualité des mains, que l’artiste devait donc corriger par la suite.

Croquis bruts (en haut) comparés au résultat final (en bas)

- L’étape suivante consistait à charger l’image dans Spotlight, un système de texturation par projection dans ZBrush, et à former les formes principales à l’aide de l’outil de génération de maillage DynaMesh.

- Le processus suivant comprenait la sculpture, la création de cartes et d’autres éléments de modélisation 3D. « J’ai obtenu un flux de travail qui répondait à mes objectifs initiaux, à savoir générer des personnages en 3D à partir d’images de diffusion stable, qui étaient en accord avec le style de ma bande dessinée », écrit Hackmans.

Comment Tales of Syn utilise-t-il ChatGPT ?

- Hackmans a mis en ligne un clip de cinq minutes sur YouTube pour montrer comment le joueur pourra interagir avec les personnages non jouables.

- Le jeu vous permet d’écrire des entrées de texte dans la fenêtre de dialogue pour déclencher certaines réponses du PNJ. Le processus est construit sur le modèle de langage GPT-3.

- Dans la séquence, le joueur demande au marchand ce qu’il vend et quelles armes il fabrique, puis détaille ses requêtes avec des invites plus spécifiques telles que « Avez-vous un outil qui peut pirater un réseau ? » ou « Pouvez-vous m’apprendre à utiliser les outils de piratage ? ».

- Il est intéressant de noter que la voix du marchand est synthétisée à l’aide de l’outil de génération de voix d’IA d’ElevenLabs.

- Hackmans a également utilisé ChatGPT pour écrire quelques scripts Unity. « Je l’ai un peu utilisé pour la navigation de mon personnage, mais il faut quand même avoir quelques connaissances pour pouvoir lui demander de corriger certaines choses ou d’améliorer les scripts », a noté le développeur sur Reddit.

- Il convient de noter que ce dialogue avec les PNJ n’est qu’un prototype, donc on ne sait pas quel niveau de liberté le joueur aura dans la version finale ou comment ce système fonctionnera dans l’ensemble du jeu.

Vous trouverez plus d’informations sur la création de personnages et de décors assistée par l’IA dans les articles complets sur le site de Tales of Syn. Hackmans révélera également plus de détails sur le jeu et son développement à la GDC 2023.