Depuis le lancement de ChatGPT en novembre 2022, ce chatbot à l’intelligence artificielle phénoménale s’est imposé comme l’un des outils d’aide à la rédaction les plus fiables d’Internet. Il est simple d’utilisation : décrivez ce que vous voulez écrire et ChatGPT l’imprime à l’écran en quelques secondes.

Cependant, à une époque où les textes générés par l’IA passent pour des textes écrits par des humains et sont utilisés pour obtenir un avantage injuste, il est très important d’identifier les contenus générés par l’IA. Mais ChatGPT n’est pas en mesure de repérer avec précision le contenu de l’IA, même son propre travail – mais pourquoi ?

Y a-t-il une différence entre un texte généré par l’IA et un texte écrit par un être humain ?

Pour que ChatGPT puisse repérer son propre texte ou tout autre texte généré par l’IA, il faut qu’il y ait une différence avec un texte écrit par un être humain. Existe-t-il donc une différence significative entre un texte écrit par un être humain et un contenu généré par l’IA ? Si c’est le cas, un outil comme ChatGPT devrait être capable de la discerner.

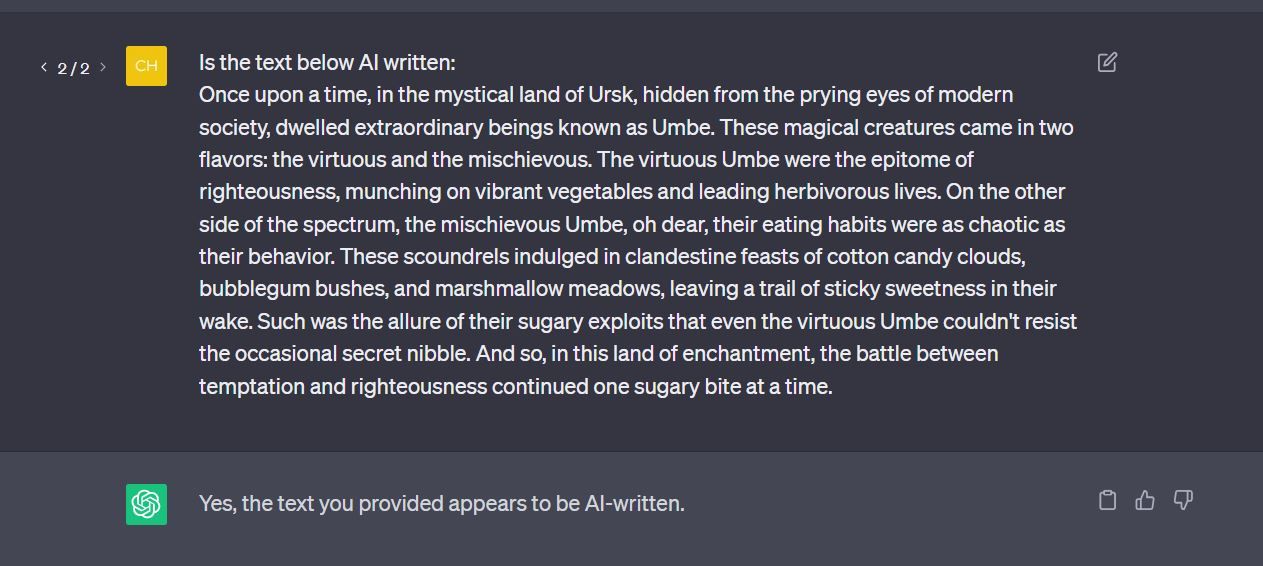

Nous avons écrit une nouvelle sans l’aide d’aucun outil d’IA et nous avons ensuite demandé à ChatGPT si cette nouvelle était un contenu écrit par l’IA. ChatGPT l’a identifié en toute confiance comme un texte généré par l’IA.

Nous avons ensuite demandé à ChatGPT de générer une histoire et, dans le même fil de discussion, nous avons copié-collé le texte généré et demandé à ChatGPT si le texte avait été créé par l’IA. La réponse de ChatGPT ? Un « non » assuré.

Dans les deux cas, ChatGPT n’a pas réussi à identifier un texte écrit par un humain ou généré par l’IA. Comment se fait-il alors que ChatGPT ne puisse pas détecter son propre texte ? Cela signifie-t-il qu’il n’y a pas de différence entre un texte généré par l’IA et un texte humain ?

Eh bien, il y en a une. Nous pourrions écrire un livre entier sur la différence entre les deux, mais cela n’aurait pas beaucoup d’importance. Alors, s’il y a une différence, pourquoi ChatGPT ou tout autre outil d’IA est-il incapable d’identifier ces différences et de distinguer avec précision un texte généré par l’IA d’un texte écrit par un humain ? La réponse se trouve dans le fonctionnement de ChatGPT et dans la manière dont il génère le texte.

Comment ChatGPT génère du texte

Lorsque vous demandez à ChatGPT de générer du texte, il tente d’imiter le processus d’écriture humain. Tout d’abord, le modèle qui sous-tend ChatGPT (Generative Pre-trained Transformer – GPT) a été entraîné sur un vaste corpus de textes humains. Des courriels, des articles sur la santé, des articles techniques, des dissertations de lycée et à peu près tous les textes que vous pouvez trouver en ligne ont été transmis au modèle au cours de la formation. ChatGPT comprend donc comment chacun de ces types de texte doit être rédigé.

Si vous demandez à ChatGPT d’écrire un courriel à votre patron, il sait à quoi doit ressembler un courriel de cette nature parce qu’il a été entraîné sur des courriels similaires, probablement des milliers. De même, si vous lui demandez d’écrire une dissertation de lycée, il sait également comment une dissertation de lycée doit sonner. ChatGPT essaiera d’écrire ce que vous voulez qu’il écrive de la même manière qu’un humain.

Mais il y a un hic. Contrairement à la façon dont les humains écrivent, ChatGPT ne comprend pas vraiment ce qu’il écrit comme le ferait un humain. Au lieu de cela, le chatbot essaie de prédire quel serait le mot suivant le plus plausible dans une phrase jusqu’à ce qu’il termine l’écriture.

Comment ChatGPT écrit par prédiction

Supposons que vous demandiez à ChatGPT d’écrire une histoire sur une ville fictive appelée Volkra. Il y a de fortes chances que le chatbot commence l’histoire par les mots « Il était une fois ». En effet, le chatbot ne pense pas par lui-même, mais essaie de prédire ce qu’un humain écrirait en se basant sur ce qu’il a appris des milliers d’histoires qu’il a reçues pendant sa formation.

Ainsi, pensant qu’un humain commencerait probablement l’histoire par les mots « Once upon », ChatGPT essaierait alors de prédire le mot logique suivant, qui serait « a » suivi de « time ». Il y aurait donc « Il était une fois… » suivi du mot logique suivant et du suivant jusqu’à ce que l’histoire soit terminée. Le ChatGPT écrit essentiellement en prédisant le mot qui viendrait naturellement (ou du moins qui a la plus grande probabilité) après dans une phrase et en l’insérant.

Ainsi, lorsqu’un outil d’IA tente de détecter si un texte est généré par l’IA, l’un des critères qu’il essaie de prendre en compte est la prévisibilité du texte, puisque les outils d’IA écrivent par prédiction. Cette mesure de la prévisibilité est appelée perplexité dans le jargon de l’IA. Lorsqu’on lui présente un texte, un outil d’IA comme ChatGPT tente d’analyser le texte pour mesurer le degré de prévisibilité de la séquence de mots ou de phrases qu’il contient. Une plus grande prévisibilité ou une faible perplexité signifie généralement que le texte est probablement généré par l’IA. Une prévisibilité moindre ou une perplexité plus élevée signifie généralement que le texte a été écrit par des humains.

Ces critères, ainsi que d’autres facteurs tels que le niveau de créativité d’un texte, ne sont malheureusement pas suffisants pour déterminer avec certitude si un texte a été rédigé par un outil d’IA ou non. En effet, les humains peuvent écrire avec une plus grande variance, comme dans l’exemple de texte que nous avons utilisé pour la démonstration au début de cet article.

Les chatbots d’IA comme ChatGPT sont conçus pour imiter autant que possible le langage humain naturel. Ainsi, alors que le texte de l’IA peut avoir des motifs discernables, ces motifs ne sont pas évidents, même pour un outil puissant comme ChatGPT. C’est la raison pour laquelle ChatGPT ne peut pas repérer son propre texte et que les outils de détection de texte d’IA ne fonctionnent pas.

ChatGPT reconnaîtra-t-il sa propre écriture à l’avenir ?

Actuellement, les outils comme ChatGPT ne peuvent pas détecter si un texte a été écrit par eux-mêmes ou par un autre outil d’intelligence artificielle, car il n’existe pas de modèle clair et discernable dans le contenu généré par l’intelligence artificielle. Toutefois, il y a de fortes chances que cela change bientôt. Grâce aux efforts déployés par des entreprises comme ChatGPT pour introduire des filigranes numériques dans le contenu généré par ChatGPT, le texte généré par le chatbot présentera un schéma plus perceptible.