Le premier iPhone, lancé en 2007, disposait d’un espace de stockage de 4 à 8 Go, où étaient conservés tous les fichiers tels que les photos et la musique. Aujourd’hui, il est possible de se procurer un smartphone Android doté d’un espace de stockage de 512 Go, soit 64 fois plus que l’iPhone original.

Dans le domaine de la technologie, 16 ans sont des siècles. Mais ce n’est pas tout. Par exemple, la mémoire et le stockage remplissent des fonctions similaires – abriter des bits et des octets – mais fonctionnent différemment.

Quelle est la différence entre la mémoire, le stockage et le cache ?

Les gens utilisent « mémoire » et « stockage » comme des synonymes. C’est logique, mais c’est faux. La similitude est évidente : les deux contiennent des données et sont mesurés en octets, mais l’utilisation diffère.

Le stockage est axé sur le long terme, eh bien… Le stockage. Les fichiers y sont conservés, sans être dérangés, jusqu’à ce qu’on en ait besoin. La mémoire (mémoire vive – RAM), quant à elle, concerne les données auxquelles les ordinateurs doivent accéder rapidement. Par exemple, les fichiers utilisés, les données relatives aux applications ouvertes et les fichiers importants du système d’exploitation sont conservés dans la mémoire système. La mémoire est en effet plus rapide que le stockage. Malheureusement, elle est aussi plus coûteuse, c’est pourquoi les capacités de la RAM sont inférieures à celles du stockage.

Mais nous allons un peu vite en besogne. Expliquons chacun d’entre eux en détail.

Mémoire cache de l’unité centrale

RAM est l’abréviation de « random access memory » (mémoire vive). Comme expliqué ci-dessus, c’est là que les données sont stockées pour être facilement accessibles.

Cependant, la mémoire cache a été créée dans les années 1980 parce que la mémoire n’était pas assez rapide à l’époque. La mémoire cache fonctionne de la même manière que la mémoire vive, mais plus rapidement. Elle se situe au sommet des tableaux de vitesse et est directement intégrée à l’unité centrale de traitement (UC) autour de laquelle votre ordinateur est construit.

La mémoire cache est extrêmement rapide, mais elle coûte encore plus cher que la mémoire vive. Ses capacités minuscules en témoignent. Par exemple, la plupart des ordinateurs actuels disposent d’environ 8 à 32 Go de RAM. En revanche, la mémoire cache la plus rapide, L1, a généralement une capacité de stockage de quelques kilo-octets, tandis que la mémoire cache L3 (la plus grande) atteint quelques dizaines de méga-octets (bien que certains processeurs aient maintenant des caches L3 mesurant des centaines de méga-octets).

Mémoire vive (RAM)

Lorsqu’il est ouvert, un fichier stocké est copié dans la mémoire vive. Les applications en cours d’exécution et certaines parties du système d’exploitation y sont également stockées. La mémoire vive a été créée vers la fin des années 1940, permettant aux données d’être stockées et récupérées dans n’importe quel ordre, d’où le nom « aléatoire ». La RAM est un « stockage volatil ». Son contenu est effacé lorsque l’appareil est éteint et que le courant s’arrête.

Il existe également de nombreux types de RAM.

SDRAM

Depuis les années 1990, les ordinateurs utilisent la mémoire vive dynamique synchrone (SDRAM). C’est ce que l’on entend lorsqu’on dit que « cet ordinateur a 16 Go de mémoire vive ».

De nombreux appareils utilisent désormais la RAM DDR5 (mémoire à double débit de 5ème génération – la dernière version au moment de la rédaction de ce document) en lieu et place de la SDRAM. Cependant, comme elle est encore chère, la DDR4 reste la plus répandue. Vous trouverez même d’anciens modules DDR3 dans des ordinateurs et des téléphones plus anciens.

Les modules de mémoire sont disponibles en deux tailles : DIMM pour les ordinateurs de bureau et SODIMM pour les ordinateurs portables et les petits ordinateurs. Récemment, un nouveau facteur de forme, CAMM, a été proposé pour les ordinateurs portables. Le CAMM présente des avantages par rapport au SODIMM, mais n’est pas encore une norme très répandue.

Aujourd’hui, il existe généralement deux types de SDRAM : les modules et les modules soudés. Les facteurs de forme diffèrent, mais ils fonctionnent de la même manière.

La RAM soudée est utilisée dans les smartphones, les tablettes et certains ordinateurs portables. Les ordinateurs Apple modernes utilisent également la RAM soudée car elle peut améliorer les performances. Les ordinateurs portables dotés de RAM soudée peuvent disposer d’un ou de plusieurs emplacements de mémoire pour une extension future, mais ce n’est souvent pas le cas. Les ordinateurs qui n’utilisent que de la mémoire vive soudée ne peuvent pas être mis à niveau. Ils peuvent généralement être personnalisés lors de l’achat, mais il n’est pas possible de les étendre par la suite.

RAM vidéo (VRAM)

Les données nécessitent parfois des vitesses supérieures à celles de la SDRAM, mais il ne s’agit pas seulement de la capacité de la mémoire cache. L’exemple le plus courant est celui des tâches graphiques intensives – jeux lourds, montage vidéo ou modélisation 3D.

Ces tâches nécessitent la bien nommée RAM vidéo (VRAM). La GDDR6X, le type le plus rapide actuellement, multiplie par 20 les vitesses de la DDR5. Elle est également soudée au GPU, ce qui garantit une latence réduite. Malheureusement, il n’est pas possible d’acheter plus de VRAM, car elle est soudée sur les cartes graphiques discrètes et non vendue sous forme de modules.

Les GPU intégrés (iGPU) sont également courants. Ils sont intégrés au processeur et disposent d’une toute petite quantité de VRAM dédiée (mégaoctets contre gigaoctets pour un GPU dédié). Les GPU intégrés utilisent une mémoire unifiée, qui est une SDRAM partagée entre le CPU et l’iGPU. L’unité centrale définit la quantité de mémoire vive disponible pour les graphiques, et en reprend une partie si nécessaire. Les inconvénients de la mémoire unifiée sont une bande passante et une capacité plus faibles.

Mémoire vive non volatile (NVRAM)

Nous avons dit que la RAM était volatile, n’est-ce pas ? Mais il y a une erreur d’appellation : la mémoire vive non volatile (NVRAM). Créée dans les années 1960, elle présente des inconvénients par rapport à la RAM volatile, si bien que cette dernière est plus populaire.

L’Optane d’Intel et de Micron est une récente NVRAM « réussie ». Ressemblant à un SSD PCIe plus rapide – et fonctionnant parfois comme tel -, Optane a fonctionné comme de la mémoire vive avec certains CPU Intel. Elle n’était pas aussi rapide que la SDRAM, et son prix et sa capacité se situaient également entre les deux. Les fabricants ont abandonné l’Optane en 2021.

Il existe deux – peut-être un et demi – types très spécifiques de NVRAM largement utilisés. Le premier est utilisé avec l’UEFI dans les cartes mères modernes (l’UEFI remplace l’ancien BIOS). Les paramètres de l’UEFI sont conservés dans la NVRAM puisqu’elle se charge avant que le stockage ne soit disponible. L’UEFI lui-même est stocké dans une puce ROM – nous y reviendrons.

Le type « demi » est une RAM volatile qui utilise des piles pour rester alimentée lorsque l’appareil est éteint. Elle est utilisée pour conserver de petites quantités de données nécessaires à des tâches plus simples. Les cartes mères qui utilisent encore l’ancien BIOS utilisent ce type de mémoire. Les anciennes consoles de jeu qui utilisaient des cartouches et/ou des cartes mémoire stockent les fichiers de sauvegarde à l’aide d’une RAM volatile et d’une batterie.

Mémoire morte (ROM)

Ces cartouches de jeux sont stockées sur des puces ROM, tout comme l’UEFI et le BIOS. Tout disque optique non réinscriptible, tel qu’un disque Blu-ray, est également un type de ROM.

Mais, ici et là, les fabricants publient des mises à jour de l’UEFI. En quoi sont-elles « en lecture seule » si elles peuvent être écrites ?

Il s’agit de ROM effaçable électriquement (EEPROM). Les mises à jour de l’EEPROM sont effectuées par des processus très lents et prudents. En effet, une mise à jour de l’UEFI ou du BIOS mal effectuée peut endommager votre carte mère.

La ROM habituelle doit également être écrite. Là encore, les détails dépendent du support. Par exemple, les ROM optiques peuvent être écrites une fois, alors que les puces ROM ont besoin de machines industrielles, puis deviennent accessibles en lecture seule. Les ROM programmables (PROM) peuvent être écrites par des dispositifs moins coûteux, et sont courantes chez les amateurs.

Stockage informatique : Du carton au nuage

Comme nous l’avons expliqué précédemment, le stockage permet de conserver les données à long terme. Les premiers ordinateurs utilisaient pour cela du carton perforé. Ils contenaient des programmes informatiques et devaient être soigneusement percés d’un code binaire lisible par la machine – ce qui n’était absolument pas convivial.

Stockage magnétique

La première évolution massive en matière de stockage informatique a eu lieu dans les années 1950, lorsque des bandes magnétiques ont été utilisées pour conserver de plus grandes quantités de données.

Le stockage magnétique était une excellente idée, et les disques durs s’en sont inspirés. Les disques durs ont été le principal type de stockage informatique depuis les années 1960 jusqu’à aujourd’hui. Mais même les meilleurs disques durs comportent des pièces mobiles qui les rendent vulnérables aux dommages et à la vitesse d’impact.

La mémoire flash, telle que les disques durs à état solide (SSD), résout ces deux problèmes. Composé de puces de silicium, comme la RAM, ce type de stockage lit et écrit les données électriquement.

Stockage externe : Les données en déplacement

Tous ces supports sont appelés « stockage interne » : ils sont conservés à l’intérieur de l’ordinateur et ne sont utilisés que là. Mais tout le monde a besoin d’emporter des données quelque part de temps en temps.

Le stockage externe est en fait aussi ancien que les ordinateurs eux-mêmes. Des cartes perforées étaient insérées dans une fente, ce qui constituait techniquement un stockage amovible. Les bandes magnétiques permettaient de stocker des données permanentes, mais les disques durs sont apparus peu après et étaient nettement plus performants. La bande était moins chère à fabriquer et les petits supports sont devenus populaires en tant que supports externes.

Elle a d’abord été remplacée par les disquettes. Les lecteurs optiques auraient dû être l’étape suivante, mais les versions réinscriptibles étaient trop chères.

Les clients se sont donc rapidement tournés vers le stockage flash. Les clés USB et les disques durs externes ou les disques SSD – les mêmes que leurs homologues internes, mais avec l’USB.

Le stockage en nuage remplace la mémoire flash en tant que support externe. Toutefois, comme il nécessite une connexion internet permanente, il ne remplacera pas complètement le stockage externe portable.

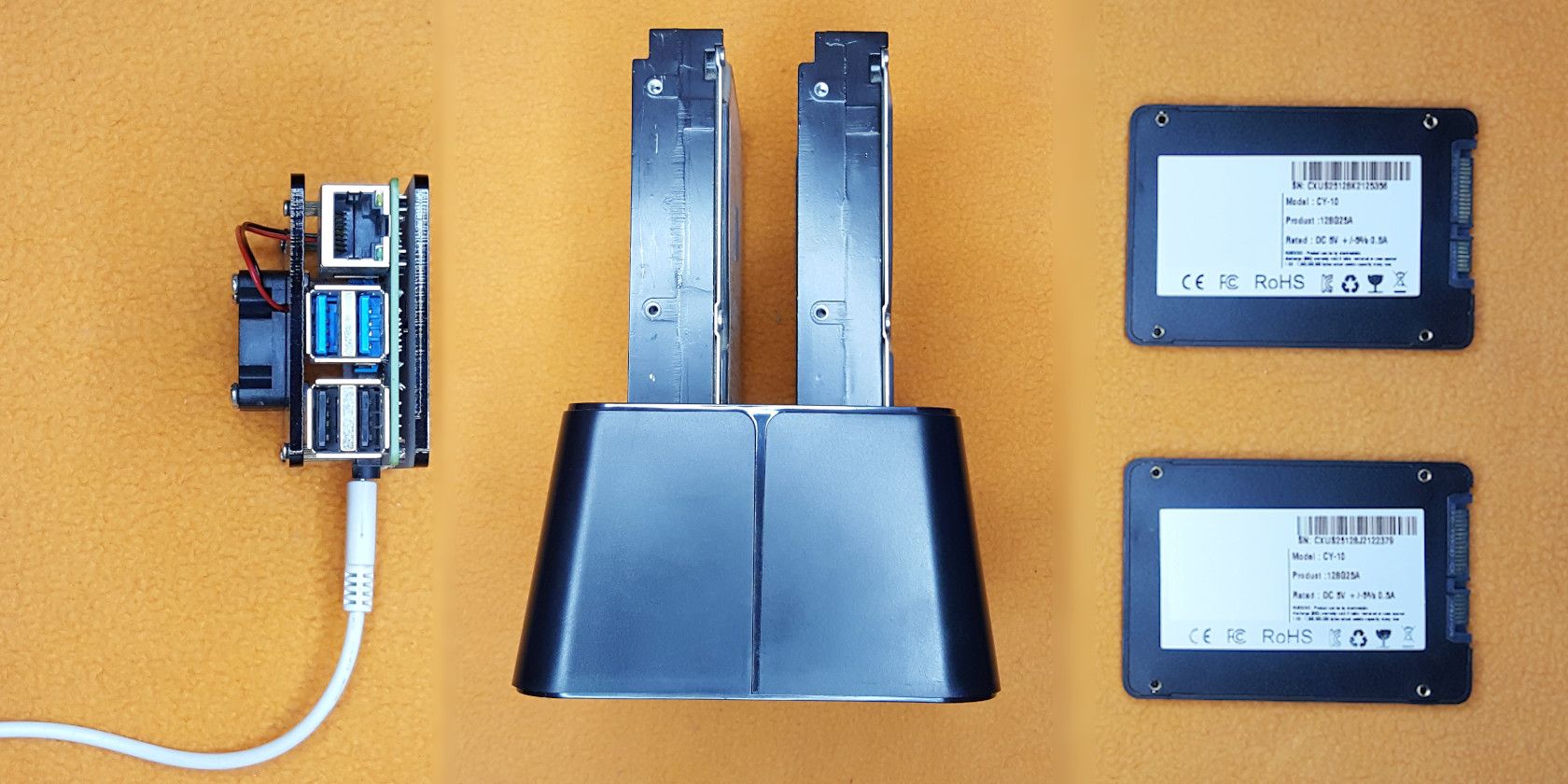

Stockage de sauvegarde

Enfin, il y a le stockage de sauvegarde. Il fonctionne comme tout autre type de stockage – les supports sont les mêmes. La différence réside dans l’intention : la sauvegarde est une sécurité intégrée.

La sauvegarde interne – lorsque le stockage interne est constitué de deux disques ou plus copiés en temps réel – n’est pas très utilisée par la plupart des gens, mais elle est cruciale pour les entreprises. Les sauvegardes externes, telles que les disques durs USB ou les disques SSD, le stockage en réseau (NAS) et même les solutions en nuage, sont plus courantes.

Les entreprises qui ont besoin d’une redondance importante des sauvegardes ont souvent recours à la « sauvegarde à froid ». Celle-ci est moins fréquente et le stockage est déconnecté des ordinateurs lorsqu’il n’est pas utilisé. Curieusement, la bande magnétique, utilisée pour la « reprise après sinistre », reste courante aujourd’hui.

Le cache, le stockage et la mémoire jouent tous des rôles différents

Le cache, la mémoire et le stockage jouent tous des rôles différents mais essentiels dans le fonctionnement de votre ordinateur. À l’avenir, nous verrons probablement la capacité de tous ces types de mémoire augmenter, et la recherche dans ce domaine est un domaine concurrentiel.